Die Miniaturisierungstrends haben in den vergangenen Jahren viele Aspekte unseres täglichen Lebens grundlegend verändert. Sie erlauben den Einsatz von Computertechnologie mit geringem Stromverbrauch für immer komplexere Berechnungen. Gleichzeitig werden vielfach Computersysteme mit Kameras ausgestattet, sei es in selbstfahrenden Autos, zur Gesichts- und Personenerkennung etwa beim Gebäudeschutz, zur Verfolgung von Warensendungen z.B. beim Paketversand, oder zur Inspektion von Gütern während der Produktion. Die Kombination von beidem, Miniaturcomputer mit eigener Kamera, hergestellt für eine ganz bestimmte Anwendung, bezeichnet man als ‘Embedded-Vision’. Die Embedded-Vision-Technologie verändert grundlegend die Art und Weise, wie wir mit den Geräten in unserer Umwelt interagieren. Mit Embedded Vision werden die Funktionen und Fähigkeiten der Produkte, die wir täglich verwenden, von Smartphones bis zu Automobilen transformiert und erweitert, um unseren Alltag zu erleichtern.

Embedded Vision verändert die Art und Weise, wie wir mit unseren Produkten interagieren, auf verschiedene Weise. Mit Hilfe von Embedded Vision können innovative Produkte auf scheinbar natürliche Weise in unser tägliches Leben integriert werden; die Grenzen zwischen Mensch und Maschine scheinen zu verschwinden, indem Embedded Vision wie selbstverständlich zunehmend Aufgaben übernimmt.

Denken Sie z.B. an die Unterhaltungselektronik, bei der Bildverarbeitungssysteme die Bewegung von Spielern in Videospielen erkennen, und den Spieler mühelos in die Spielewelt integrieren. Es ist kein Controller mehr erforderlich, der die gewünschten Aktionen des Spielers an die Spielekonsole übermittelt. Das System kann automatisch die Bewegungen des Spielers interpretieren und in das Spiel übertragen. In diesem Szenario ist die Interaktion mit dem Videospiel und der Konsole weitaus natürlicher als bei der Verwendung eines Controllers.

Embedded Vision kann noch mehr

Mit Embedded Vision ausgestattete Produkte können darüber hinaus unsere bestehenden Fähigkeiten erweitern. Beispielsweise kann eine Augmented Reality (AR) Brille dazu benutzt werden, einem Service-Ingenieur Montageanweisungen einzublenden. Diese Anweisungen könnten in Echtzeit aktualisiert werden, um Teile, die gerade montiert werden müssen, an ihrer aktuellen Position farblich hervorzuheben. Damit können Mitarbeitende neue Montageaufgaben in unbekannten Umgebungen übernehmen, selbst wenn er oder sie die Arbeiten noch nie zuvor durchgeführt hat.

Mit Embedded Vision ausgestattete Systeme sind in der Lage ihre Position in der Umwelt zu erkennen und die Umwelt zu erkunden (Simultaneous Location and Mapping = SLAM). Solche SLAM-Systeme können in unzugänglichen Bereichen Rettungsaktionen unterstützen, z.B. bei einem Grubenunglück oder bei Unfällen in Tunnels.

Embedded Vision hat ein unglaubliches Potenzial und verwandelt die damit ausgestatteten Produkte vollständig. Da sich diese Technologie derzeit rapide weiterentwickelt und immer mehr Produkte diese Technologien nutzen, wird sich die Art und Weise, wie wir mit unseren Produkten interagieren, weiter verbessern.

Udo Birk

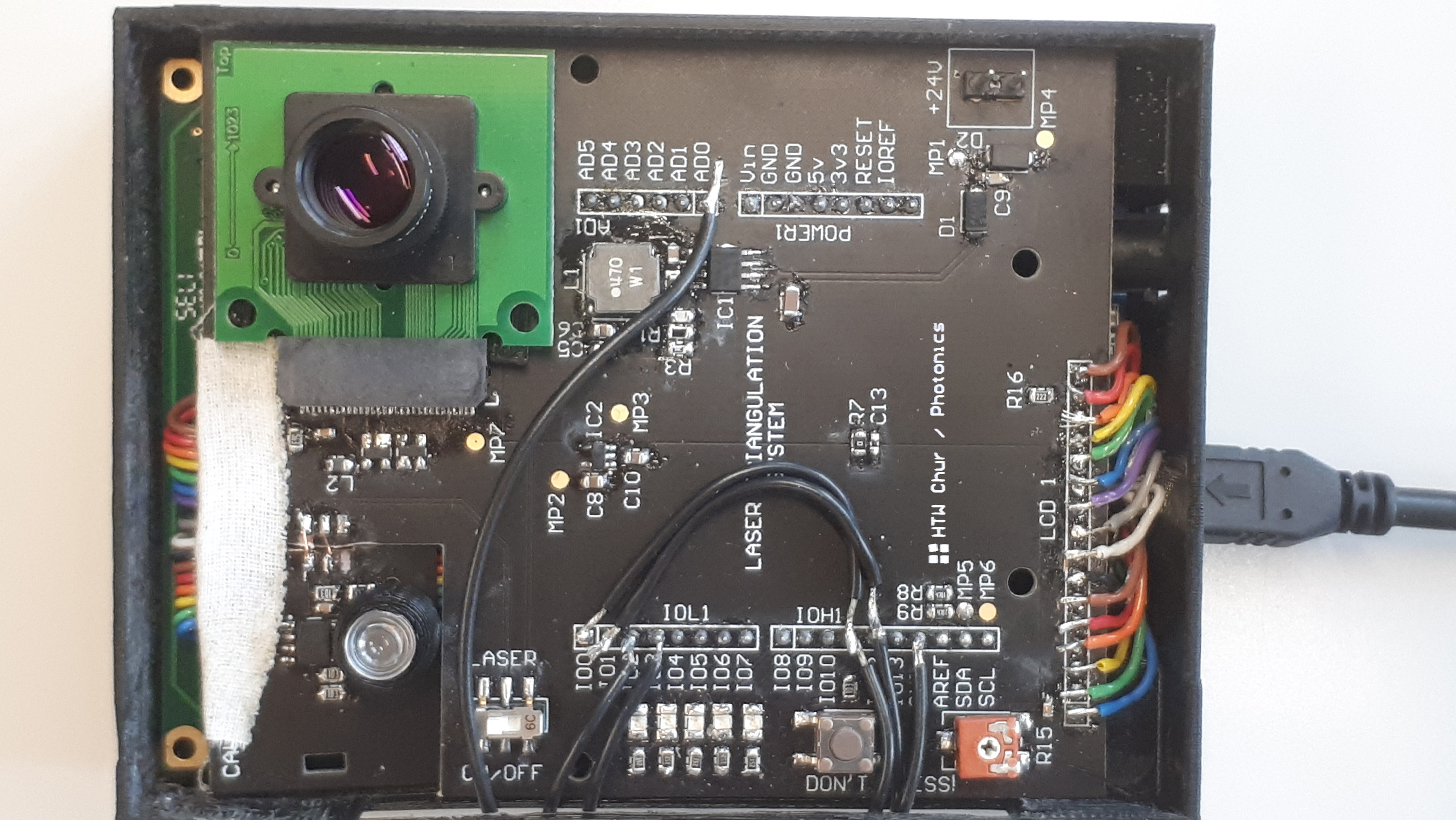

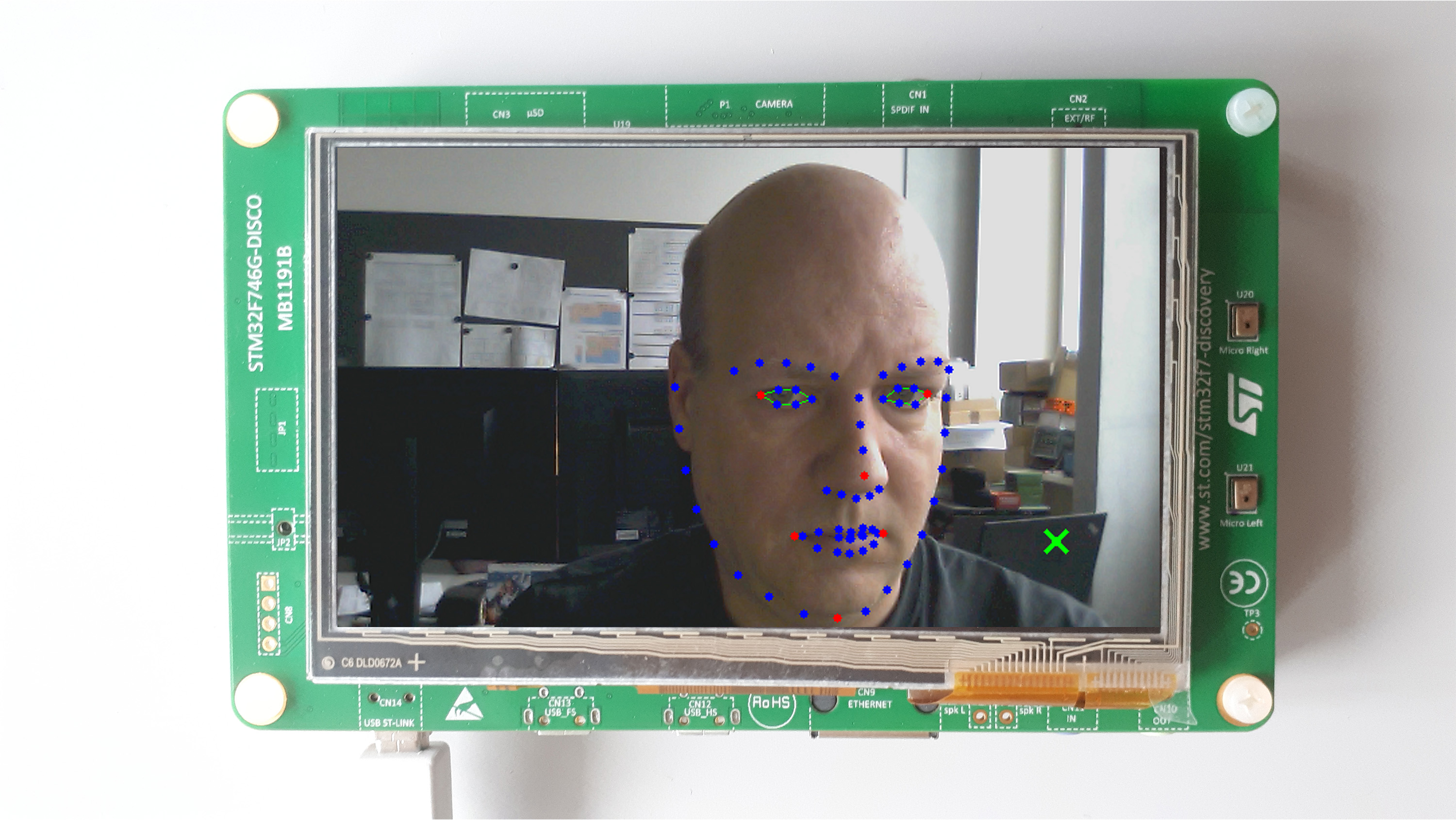

PD Dr. Udo Birk ist Dozent für Bildverarbeitung im schweizweit einmaligen Bachelorangebot Photonics und Leiter Weiterbildung für das CAS Bildverarbeitung und das CAS Optoelektronik an der HTW Chur.

Ich habe zuletzt ein Projekt mit dem Kinect Sensor realisiert, bei dem ich nach Besonderheiten im Bewegungsablauf gesucht habe. Die Patienten hatten z.T. unspezifische Schmerzen, und die Ärzte wollten ausschliessen, dass die Schmerzen auf Fehlhaltungen zurückzuführen sind. Aber wenn das mit einem Embedded Vision System ginge, das wäre schon klasse.

Es wäre megacool, wenn ich mit so einem Device mein TV-Gerät nur mit dem Gesicht und mit Kopfbewegungen steuern könnte. Momentan bin ich mit der Sprachsteuerung echt unglücklich, obwohl das doch eigentlich besser funktionieren müsste.